チトセロボティクス(東京・文京区)は6月17日、生成AI(人工知能)技術を活用し、自然言語と画像入力だけで産業用ロボットの動作指示ができるシステム「自然言語動作指示システム」の研究開発を開始したと発表した。

開発するのは、大規模言語モデル(LLM)および視覚言語モデル(VLM)を活用し、専門的なプログラミング知識がなくても、作業者が日本語の指示と画像入力で産業用ロボット制御するシステム。

従来の産業用ロボットの制御では、「教示再生方式(ティーチング)」でロボットに動作を覚えさせる必要があり、専用ソフトやハード、専門的なスキルも求められていた。新システムは、この教示プロセスを根本的に見直し、一般作業者が自然言語と視覚的な入力のみで、直感的に産業用ロボットを制御できる新たなアプローチを目指す。

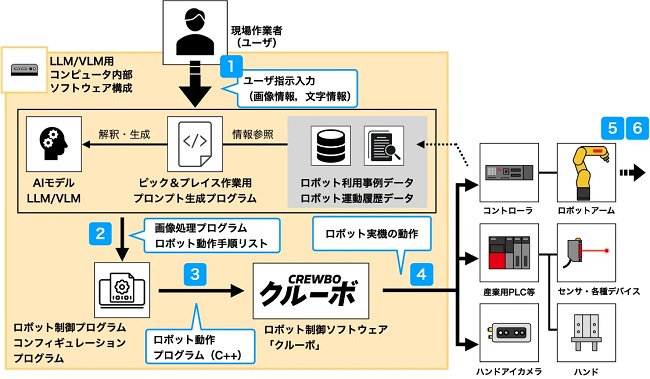

具体的には。ユーザーが「青い電線をピッキングして横に置いてください」といった日本語の作業指示を与え、対象物を写した画像をアップロードすると、視覚的な情報もロボットに提示。

受け取った自然言語と画像情報を基に、LLM(大規模言語モデル)とVLM(視覚言語モデル)が作業指示の意味を解釈し、対象物検出の画像認識プログラム、移動、把持、リリースなどのロボットの基本動作命令列、動作手順をまとめたシーケンスと、これらを統合したC++実行プログラムやパラメータファイルを自動で生成する。

生成されたコードは、チトセロボティクスのロボット制御ソフト「クルーボ」と連携し、実機ロボットに直接適用する。

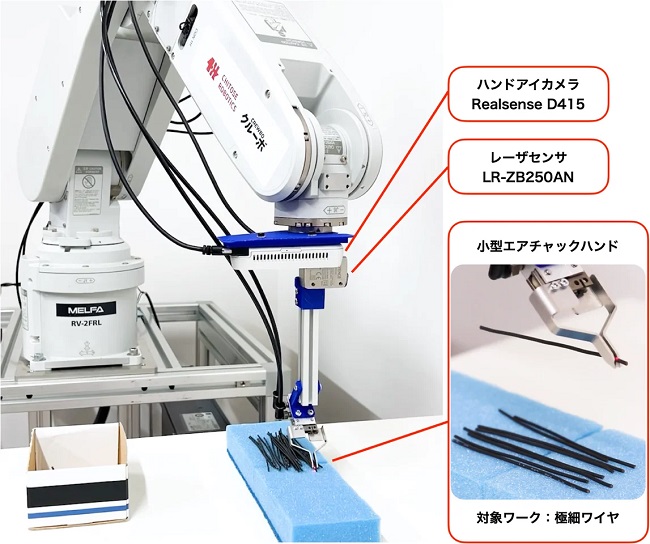

動作実行時には、ロボットに搭載したハンドアイカメラやレーザーセンサーの映像フィードバックを利用し、リアルタイムで位置補正・把持修正を実施。0.02mm以下の位置精度での把持や配置動作を可能にして、従来のティーチング方式よりも柔軟で高精度な作業をできるようにする。

チトセロボティクスによると、近年、製造業を中心に産業用ロボットの導入が進んでいるが、熟練オペレーターの不足や多品種少量生産対応の難しさなどの課題が浮上しており、従来の「教示再生方式」では対応が困難になっているという。

そこで、同社では、この課題解決で、生成AIを活用し、プログラミング不要で直感的なロボット制御システムを開発することで、産業用ロボットの導入障壁を下げることを目指している。